En ce mois de mars 2026, 800 millions de personnes utilisent ChatGPT chaque semaine. Google affiche des réponses générées par IA sur plus de la moitié de ses résultats de recherche. Et selon Forrester (Buyers' Journey Survey, 2024), 89% des acheteurs B2B utilisent déjà l'IA générative dans leur processus d'achat. Derrière cette transformation, un mécanisme technique détermine quels contenus sont sélectionnés pour alimenter les réponses de ces moteurs : le RAG, pour Retrieval-Augmented Generation. Comprendre ce mécanisme, c'est comprendre les nouvelles règles du jeu de la visibilité en ligne. Voici pourquoi, et surtout comment en tirer parti.

Le RAG : la bibliothèque vivante de l'intelligence artificielle

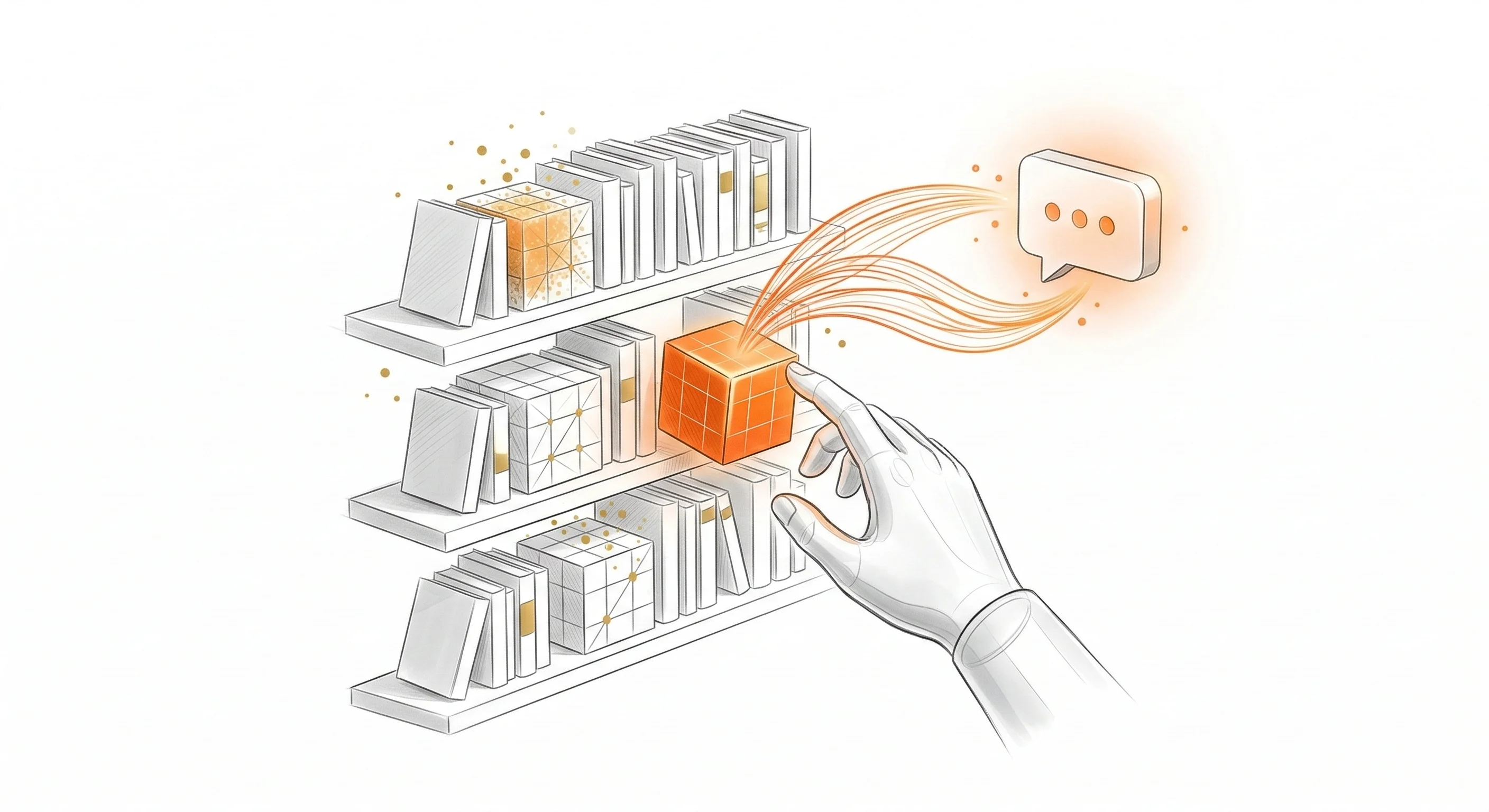

Pour saisir ce que le RAG change au référencement, il faut d'abord comprendre ce qu'il est. L'analogie la plus parlante est celle de la bibliothèque. Imaginez un expert que vous consultez pour résoudre un problème complexe. Cet expert a une mémoire prodigieuse, mais figée : il connaît tout ce qu'il a appris jusqu'à une date précise, et rien après. C'est un LLM (Large Language Model) classique, comme GPT-4 ou Claude, sans accès à des données externes. Il répond avec conviction, mais parfois avec des informations périmées, voire inventées. C'est ce que l'on appelle les hallucinations.

Le RAG transforme cet expert en quelque chose de plus fiable : un chercheur qui, avant de vous répondre, se lève, va consulter les ouvrages les plus récents dans une bibliothèque constamment mise à jour, puis revient avec une réponse fondée sur des sources vérifiables. Techniquement, le processus se décompose en deux étapes distinctes. D'abord, la phase de retrieval (récupération) : le système reçoit une question, la transforme en vecteur mathématique, puis cherche dans un index de documents les passages les plus sémantiquement proches de cette question. Ensuite, la phase de generation (génération) : le modèle de langage produit une réponse cohérente en s'appuyant sur ces documents récupérés, qu'il synthétise et reformule.

Ce concept a été formalisé pour la première fois en 2020 par une équipe de recherche de Facebook AI (aujourd'hui Meta), dans un article fondateur intitulé "Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks". Depuis, il est devenu l'architecture dominante de tous les moteurs de recherche génératifs, de Google AI Overviews à ChatGPT en passant par Perplexity et Bing Chat.

Pourquoi le RAG est devenu central en mars 2026

Le contexte rend ce sujet urgent. En février 2024, Gartner prédisait une baisse de 25% du volume de recherche traditionnel d'ici fin 2026, au profit des chatbots et agents virtuels alimentés par l'IA générative. Un an plus tard, les signaux convergent. D'après les données de DemandSage (mars 2026), ChatGPT traite désormais 2,5 milliards de requêtes par jour, contre un milliard en 2025. Google AI Overviews touche 1,5 milliard d'utilisateurs mensuels. Et le trafic référé par les outils d'IA vers les sites de e-commerce a bondi de 520% entre 2024 et 2025, selon les données compilées par Incremys (janvier 2026).

Pour les entreprises B2B, ces chiffres cachent un changement de nature, pas seulement d'échelle. La donnée la plus révélatrice vient de Forrester : dans son enquête Buyers' Journey Survey 2024, l'IA générative a immédiatement figuré parmi les sources d'information les plus citées par les acheteurs B2B, toutes phases du cycle d'achat confondues, de la découverte de fournisseurs à la justification de la décision finale. Dans l'édition 2025 de cette même enquête, l'IA générative est devenue le type d'interaction le plus cité pour la recherche d'achats. Les acheteurs B2B adoptent ces outils trois fois plus vite que les consommateurs grand public.

Autrement dit : vos prospects ne vous cherchent plus seulement sur Google. Ils demandent à ChatGPT quel CRM choisir, à Perplexity quel prestataire de prospection recommander, à Gemini comment comparer deux solutions d'automatisation. Et la réponse qu'ils obtiennent est construite par un système RAG qui sélectionne, parmi des millions de contenus, ceux qu'il juge les plus fiables et les plus pertinents. Si votre contenu n'est pas sélectionné, vous n'existez pas dans cette conversation.

Ce que le RAG change fondamentalement au SEO classique

Le SEO traditionnel repose sur un principe simple : se positionner le plus haut possible dans une liste de liens. L'utilisateur clique, visite le site, consomme le contenu. Le RAG casse cette logique sur trois plans.

Premier changement : la granularité de la sélection. Un moteur de recherche classique indexe et classe des pages. Un système RAG découpe ces pages en fragments (chunks), les convertit en vecteurs, et sélectionne les passages les plus pertinents pour une requête donnée. La conséquence est directe : ce n'est plus votre page qui est sélectionnée, c'est un paragraphe, une phrase, un chiffre. D'après une analyse publiée en septembre 2025 par le consultant SEO Ralf van Veen, les systèmes RAG ne récupèrent pas des pages entières mais des fragments immédiatement exploitables. Chaque paragraphe doit être compréhensible de manière autonome.

Deuxième changement : la disparition du clic comme métrique centrale. En SEO classique, un bon positionnement vise un taux de clic (CTR) élevé. Avec les réponses génératives, l'utilisateur obtient sa réponse directement dans l'interface du chatbot. Selon les données d'Incremys, 60% des recherches se terminent désormais sans aucun clic (zero-click). Le taux de clic en première position avec un AI Overview tombe à 2,6%. L'objectif n'est donc plus d'attirer un clic, mais d'être la source citée dans la réponse.

Troisième changement : la concentration des sources. Un résultat Google affiche classiquement dix liens bleus. Un moteur génératif, lui, ne cite que deux à sept sources en moyenne par réponse, d'après l'analyse de Profound (juillet 2025). La compétition pour apparaître dans ces quelques places est donc considérablement plus intense.

Les limites du RAG : ce qu'il faut savoir pour ne pas se tromper de stratégie

Avant de se lancer dans l'optimisation, il faut comprendre les faiblesses structurelles du RAG. Ce n'est pas un système infaillible, loin de là.

La première limite est la qualité de la récupération. Un système RAG ne peut citer que ce qu'il trouve. Si votre contenu est techniquement inaccessible (bloqué aux crawlers, rendu en JavaScript pur, sans données structurées), il ne sera jamais indexé, donc jamais récupéré. C'est exactement ce que soulignait John Mueller, de l'équipe Google Search, en rappelant que la phase de "retrieval augmented" du RAG repose fondamentalement sur les mêmes principes que le SEO classique : rendre le contenu crawlable et indexable.

La deuxième limite concerne les hallucinations résiduelles. Même avec le RAG, les modèles peuvent mal interpréter ou déformer les sources récupérées. Forrester (Buyers' Journey Survey, 2025) rapporte que 19% des acheteurs B2B utilisant l'IA générative se disent moins confiants dans leurs décisions à cause d'informations inexactes ou trompeuses produites par ces outils. Ce n'est pas anecdotique : Forrester prédit même qu'une entreprise du Fortune 500 poursuivra en justice un fournisseur B2B en 2026 pour des informations erronées générées par l'IA.

La troisième limite est le biais de popularité. Les systèmes RAG tendent à favoriser les contenus déjà bien classés dans les moteurs traditionnels. D'après les données compilées par Incremys, 99% des citations dans les AI Overviews de Google proviennent du top 10 organique, et 87% des citations de ChatGPT correspondent aux meilleurs résultats de Bing. Autrement dit, le RAG ne remplace pas le SEO classique : il s'y superpose. Il faut d'abord bien se positionner dans les moteurs traditionnels pour avoir une chance d'être cité par les moteurs génératifs.

Enfin, la quatrième limite tient à la fragmentation du contenu. Puisque le RAG découpe les pages en fragments, un article mal structuré dont les paragraphes sont interdépendants et incompréhensibles isolément sera pénalisé. Un paragraphe qui commence par "comme nous l'avons vu plus haut" et ne contient aucune information autonome sera ignoré par le système de récupération.

Le GEO : le nouveau cadre d'optimisation qui complète le SEO

Face à cette transformation, un nouveau champ d'expertise est né : le GEO, pour Generative Engine Optimization. Le terme a été formalisé en novembre 2023 par des chercheurs de Princeton, Georgia Tech, l'Allen Institute for AI et l'IIT Delhi, dans un article académique publié ensuite à la conférence ACM SIGKDD 2024. Leur conclusion centrale : les techniques de GEO peuvent augmenter la visibilité d'un contenu dans les réponses génératives de 40%. Mieux encore, les sites moins bien positionnés dans les résultats classiques sont ceux qui bénéficient le plus de ces optimisations. Les auteurs rapportent que la méthode d'ajout de citations a généré une hausse de visibilité de 115% pour les sites classés en cinquième position dans les résultats organiques.

Le marché du GEO croît en conséquence. Selon Incremys, le marché mondial du GEO pesait 886 millions de dollars en 2024 et devrait atteindre 7,3 milliards de dollars en 2031, soit un taux de croissance annuel composé de 34%. En parallèle, 63% des entreprises ayant optimisé leur contenu pour le GEO constatent une augmentation de leur visibilité dans les moteurs génératifs.

Pour autant, il est essentiel de ne pas opposer GEO et SEO. Comme le résume une analyse d'Enrich Labs (début 2026) : le GEO n'est pas un remplacement du SEO, mais une couche additionnelle. Les entreprises qui excellent en GEO en 2026 sont généralement celles qui disposent déjà de fondations SEO solides. Les principes se chevauchent, mais le GEO ajoute des exigences spécifiques autour de la structure du contenu, de sa capacité à être cité, et de sa densité en données.

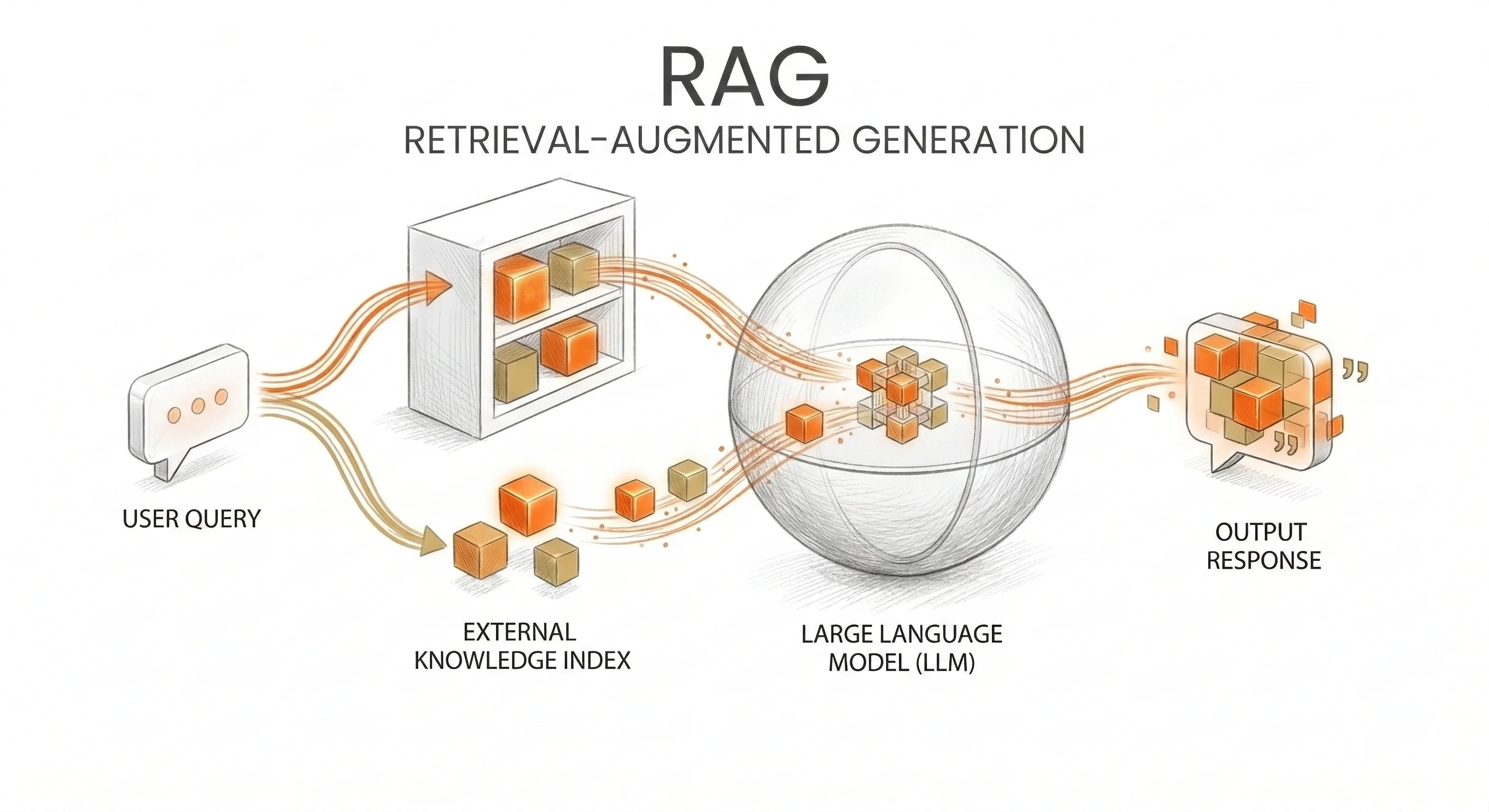

Sept leviers concrets pour que l'IA vous cite

Passons à ce qui intéresse tout dirigeant commercial : que faire concrètement ? Les données issues de la recherche académique et des analyses de terrain convergent sur plusieurs leviers d'action, classés par impact décroissant.

1. Structurer chaque paragraphe comme une réponse autonome

C'est le principe le plus contre-intuitif pour un rédacteur formé au style narratif. Dans un article classique, les paragraphes s'enchaînent, chacun dépendant du précédent pour être compris. Or le RAG ne récupère pas l'article entier : il sélectionne des fragments. Chaque paragraphe doit donc contenir une information complète et compréhensible sans contexte. L'analogie : pensez à chaque paragraphe comme à une fiche encyclopédique, pas comme à un chapitre de roman. Concrètement, cela signifie placer la réponse directe dans les 40 à 60 premiers mots de chaque section, comme le recommande l'analyse de Frase.io (novembre 2025). C'est ce qu'on appelle la structure "TLDR-first" : la conclusion d'abord, le développement ensuite.

2. Intégrer des données chiffrées vérifiables toutes les 150 à 200 mots

Les systèmes RAG priorisent les contenus à forte densité factuelle. L'étude de Princeton/Georgia Tech a démontré que l'ajout de statistiques sourcées augmente significativement la visibilité dans les réponses génératives. Selon Frase.io, la fréquence optimale est d'une donnée chiffrée tous les 150 à 200 mots. Chaque statistique doit être accompagnée d'une source identifiable (nom de l'organisme, date de publication). Le contenu qui affirme "le marché croît fortement" sera systématiquement écarté au profit de celui qui précise "le marché a progressé de 34% en 2025, selon Gartner".

3. Citer des sources autoritaires et vérifiables

C'est la découverte la plus frappante de l'étude GEO de Princeton : l'ajout de citations est la technique qui génère le plus fort impact sur la visibilité. Les moteurs génératifs, critiqués pour leurs hallucinations, surpondèrent les contenus qui citent des sources crédibles. L'explication est logique : un contenu qui cite Gartner, Forrester ou McKinsey offre au système RAG une double validation, celle de l'auteur du contenu et celle de la source citée. Pour une PME B2B, cela implique d'ancrer systématiquement ses affirmations dans des données publiques vérifiables, issues d'études sectorielles, de rapports d'analystes ou de données institutionnelles.

4. Implémenter un balisage structuré (schema markup)

Les données structurées (schema.org) facilitent l'extraction d'informations par les systèmes RAG. D'après une étude SEMrush citée par Stakque (décembre 2025), les sources disposant d'un schema markup correctement implémenté reçoivent 67% de citations en plus dans les réponses génératives. Les balises FAQ, HowTo et Article sont particulièrement efficaces. Pour un site B2B, cela passe par le balisage des pages FAQ, des comparatifs produits, des études de cas et des guides pratiques.

5. Construire des clusters thématiques cohérents

Les systèmes RAG comprennent les relations entre concepts. Un site qui traite un sujet de manière isolée sera moins bien évalué qu'un site qui couvre un thème en profondeur à travers plusieurs articles interconnectés. Toujours selon l'étude citée par Stakque, les clusters thématiques améliorent le taux de citation de 54% par rapport aux articles isolés. Pour une entreprise B2B spécialisée en prospection, cela signifie couvrir le sujet sous tous ses angles : CRM, lead scoring, automatisation, cold email, ABM, chacun avec des articles dédiés qui se renvoient les uns aux autres.

6. Optimiser pour les featured snippets

Les contenus déjà formatés pour les extraits enrichis de Google s'alignent naturellement avec les modèles de récupération du RAG. L'optimisation pour les featured snippets augmente la probabilité de citation par l'IA de 89%. Concrètement : répondre directement aux questions dans les deux premières phrases qui suivent un sous-titre de type H2 ou H3, utiliser des tableaux comparatifs pour les données structurées, et formuler les sous-titres sous forme de questions correspondant aux requêtes réelles des utilisateurs.

7. Dater et mettre à jour le contenu régulièrement

Les moteurs génératifs privilégient la fraîcheur. Un guide daté de 2023, même excellent, sera écarté au profit d'un contenu équivalent mis à jour en 2026. L'indication visible "Dernière mise à jour : mars 2026" agit comme un signal de confiance pour les systèmes de récupération. D'après Enrich Labs, les contenus qui incluent un ancrage temporel explicite ("En date de mars 2026...") surperforment systématiquement les contenus dits "evergreen" sans marquage temporel pour les requêtes sensibles à l'actualité.

Au-delà du contenu : les signaux externes qui comptent

L'optimisation du contenu ne suffit pas. Les moteurs génératifs évaluent aussi la réputation et la présence globale d'une marque sur le web. Selon une analyse de Search Engine Land (février 2026), les sources les plus citées par les LLM en octobre 2025 incluaient Reddit, LinkedIn et YouTube. Ce n'est pas un hasard : ces plateformes hébergent des discussions authentiques, des témoignages d'utilisateurs et des contenus d'expertise que les systèmes RAG considèrent comme des signaux de confiance complémentaires au site principal.

Pour une PME B2B, cela implique de ne pas concentrer tous ses efforts sur son seul blog. Les avis clients sur G2, Capterra ou Trustpilot, les interventions dans des communautés professionnelles, les prises de parole d'experts sur LinkedIn, les articles de presse sectorielle mentionnant l'entreprise : autant de signaux qui renforcent la probabilité d'être sélectionné par un système RAG. Forrester résume cette logique ainsi : lorsque plusieurs sources indépendantes mentionnent une marque dans des contextes pertinents, les systèmes d'IA disposent de signaux plus clairs pour évaluer sa crédibilité.

La logique des backlinks en SEO classique trouve ici son équivalent : ce que certains experts appellent désormais la "citation equity", c'est-à-dire l'autorité accumulée au fil des mentions et citations dans les réponses génératives. Les entreprises qui investissent tôt dans cette dynamique capitalisent un avantage compétitif qui se renforce avec le temps.

Le cas particulier des acheteurs B2B : pourquoi le RAG vous concerne directement

Un dirigeant de PME pourrait être tenté de considérer que ces enjeux concernent surtout le e-commerce ou les médias. Ce serait une erreur. Les données Forrester montrent que l'adoption de l'IA générative par les acheteurs B2B est non seulement massive mais qu'elle transforme en profondeur les comportements d'achat.

Selon le rapport Predictions 2025 de Forrester, plus de 90% des acheteurs ayant utilisé l'IA générative pour des achats de plus d'un million de dollars rapportent des résultats positifs. L'IA leur permet de mener des recherches plus approfondies, de réduire les biais et d'évaluer un plus grand nombre de fournisseurs. Forrester prédit que cela conduira les acheteurs B2B à considérer systématiquement cinq fournisseurs ou plus pour les achats importants, là où ils en évaluaient souvent trois auparavant.

Ce qui change pour un prestataire B2B est fondamental : le premier contact avec un prospect a lieu de plus en plus souvent dans un chatbot, pas sur votre site. Si ChatGPT recommande trois solutions de prospection B2B et que vous n'en faites pas partie, vous êtes invisible pour une part croissante de vos prospects potentiels. D'après les données de Forrester (juillet 2025), le trafic issu de la recherche conversationnelle représentait entre 2% et 6% du trafic organique total en B2B au premier semestre 2025, avec une croissance de plus de 40% par mois. Forrester estimait que ce chiffre atteindrait 20% ou plus d'ici fin 2025.

Un détail supplémentaire mérite attention : les visiteurs provenant d'outils d'IA passent jusqu'à trois fois plus de temps sur les pages que ceux provenant de la recherche traditionnelle, selon les témoignages recueillis par Forrester auprès de directeurs marketing B2B. Leurs requêtes sont aussi plus complexes, avec une moyenne de 15 à 23 mots par question, contre les deux à cinq mots typiques d'une recherche Google. Ce sont des visiteurs mieux informés, avec une intention d'achat plus élevée.

| Indicateur | Valeur | Source |

|---|---|---|

| Acheteurs B2B utilisant l'IA générative | 89% | Forrester, Buyers' Journey Survey 2024 |

| Utilisateurs hebdomadaires de ChatGPT | 800+ millions | DemandSage (mars 2026) |

| Baisse prédite du volume de recherche traditionnelle d'ici fin 2026 | -25% | Gartner (février 2024) |

| Hausse de visibilité GEO avec citations sourcées | +40% | Princeton/Georgia Tech, ACM SIGKDD 2024 |

| Part des AI Overviews citant le top 10 organique | 99% | Incremys (janvier 2026) |

| Recherches se terminant sans clic (zero-click) | 60% | Incremys (janvier 2026) |

| Sources moyennes citées par réponse générative | 2 à 7 | Profound (juillet 2025) |

Plan d'action en cinq priorités pour une PME B2B

Ces principes sont clairs, mais leur mise en pratique demande de la méthode. Voici les cinq chantiers prioritaires pour un responsable marketing ou commercial B2B qui découvre le sujet.

Première priorité : auditer sa visibilité dans les moteurs génératifs. Avant d'optimiser quoi que ce soit, il faut mesurer. Tapez les dix requêtes que vos prospects formulent le plus souvent dans ChatGPT, Perplexity et Google (avec AI Overview activé). Notez si votre marque, vos articles ou vos données sont cités. Si la réponse est non dans les trois cas, vous partez de zéro, ce qui est le cas de la majorité des PME en mars 2026. D'après Enrich Labs, la plupart des équipes marketing des PME n'ont pas encore démarré de démarche GEO, ce qui représente une fenêtre d'opportunité pour les premiers entrants.

Deuxième priorité : restructurer les contenus existants. Pas besoin de tout réécrire. Il s'agit de reprendre vos articles les plus performants en SEO classique (ceux qui génèrent déjà du trafic organique) et de les adapter. Ajoutez un résumé direct dans les 60 premiers mots de chaque section. Insérez des données chiffrées sourcées. Reformulez les sous-titres sous forme de questions. Ajoutez une date de mise à jour visible. Ce travail de restructuration peut être réalisé en quelques jours sur les dix à quinze articles clés de votre blog.

Troisième priorité : investir dans les FAQ structurées. Les pages FAQ balisées en schema.org sont les contenus les plus fréquemment cités par les moteurs génératifs, tous secteurs confondus. Identifiez les quinze questions les plus fréquentes de votre marché, rédigez des réponses factuelles de 50 à 100 mots chacune, intégrez-les sur les pages concernées avec un balisage FAQPage. C'est le levier à plus fort impact pour un investissement minimal.

Quatrième priorité : renforcer votre présence sur les plateformes tierces. Publiez des analyses sur LinkedIn. Répondez à des questions sur des forums sectoriels. Sollicitez des avis clients sur les plateformes d'évaluation B2B. Chaque mention de votre marque dans un contexte pertinent est un signal supplémentaire pour les systèmes RAG. En B2B, les analyses d'experts et les réseaux sociaux figurent parmi les contenus que les acheteurs trouvent les plus significatifs, d'après le Buyers' Journey Survey 2025 de Forrester.

Cinquième priorité : produire de la donnée originale. C'est le levier le plus puissant à moyen terme, et aussi le plus difficile à imiter. Un sondage mené auprès de vos clients, un benchmark sectoriel compilé à partir de vos données internes, une étude de cas documentée avec des chiffres précis : ce type de contenu est exactement ce que les systèmes RAG recherchent en priorité. Les moteurs génératifs ont besoin de données originales, pas de reformulations de données existantes. Une PME qui publie un "Baromètre de la prospection B2B en France" basé sur ses propres données clients crée un actif qui sera cité pendant des mois.

Questions fréquentes

Le RAG va-t-il remplacer le SEO classique ?

Non. Le RAG s'appuie massivement sur les résultats des moteurs traditionnels. Selon les données d'Incremys (janvier 2026), 99% des citations dans les AI Overviews proviennent du top 10 organique. Le SEO reste la fondation indispensable. Le GEO est une couche d'optimisation supplémentaire, pas un substitut.

Quel budget faut-il prévoir pour optimiser son contenu pour le GEO ?

L'optimisation GEO ne nécessite pas d'investissement technique lourd. Elle repose principalement sur la restructuration de contenus existants (compter 2 à 5 jours de travail pour un blog de 20 articles), l'ajout de balisage schema.org (500 a 2 000 euros si externalisé), et la production régulière de données originales. Le coût principal est le temps éditorial, pas l'outillage.

Comment savoir si ChatGPT ou Perplexity cite mon contenu ?

En mars 2026, plusieurs outils permettent de suivre sa visibilité dans les moteurs génératifs : Profound, SEMrush Enterprise AIO et Superlines sont les principaux. Pour un suivi manuel, testez régulièrement les requêtes clés de votre marché dans ChatGPT et Perplexity. Analysez aussi vos logs serveur pour identifier le trafic provenant des bots d'IA (OAI-SearchBot pour OpenAI, PerplexityBot, Google-Extended).

Les PME B2B sont-elles vraiment concernées ou seulement les grands groupes ?

Les PME sont les premières concernées. D'après Enrich Labs (début 2026), la plupart des grandes entreprises ont déjà lancé des initiatives GEO, tandis que la majorité des PME n'ont pas encore commencé. C'est précisément ce décalage qui crée une opportunité : les premiers entrants accumulent un avantage de citation qui se renforce avec le temps.

Quelle est la différence entre GEO et AEO (Answer Engine Optimization) ?

Les deux termes désignent essentiellement la même discipline. L'AEO a émergé initialement dans le contexte de la recherche vocale, le GEO dans celui des moteurs génératifs. En mars 2026, les deux concepts ont convergé puisque les requêtes vocales transitent désormais par les mêmes systèmes génératifs. Le terme GEO tend à s'imposer dans la communauté, mais les principes d'optimisation sont identiques.

Faut-il produire plus de contenu ou mieux structurer l'existant ?

La priorité est la qualité et la structure, pas le volume. Les systèmes RAG privilégient la densité factuelle, la clarté sémantique et l'autorité des sources. Un article de 2 000 mots bien structuré, riche en données et correctement balisé sera toujours préféré à dix articles superficiels de 500 mots. Commencez par optimiser vos contenus existants les plus performants avant de produire du neuf.

Ce qu'il faut retenir

Le RAG n'est pas une abstraction technique réservée aux ingénieurs. C'est le mécanisme qui décide, en temps réel, quelles entreprises sont visibles et lesquelles sont ignorées quand un prospect pose une question à une IA. En ce mois de mars 2026, avec 89% des acheteurs B2B qui utilisent l'IA générative dans leur parcours d'achat, cette question n'est plus théorique.

La bonne nouvelle : les fondamentaux du SEO restent la base. La mauvaise : ils ne suffisent plus. Les trois actions les plus rentables à court terme sont la restructuration des contenus existants pour les rendre "RAG-ready" (paragraphes autonomes, données chiffrées, sources citées), l'implémentation de schema markup sur les pages clés, et l'audit régulier de sa visibilité dans les principaux moteurs génératifs. Les PME qui s'y engagent maintenant construisent un avantage compétitif que leurs concurrents mettront des mois à combler.

Sources et références

- Gartner, prédiction baisse de 25% du volume de recherche (février 2024)

- Forrester, B2B Buyer Adoption of Generative AI, Buyers' Journey Survey 2024

- Forrester, Predictions 2025: Business Buyers and GenAI

- Forrester, Buyers' Journey Survey 2025 via Digital Commerce 360

- Forrester, AI Search Reshaping B2B Marketing (juillet 2025)

- Aggarwal et al., GEO: Generative Engine Optimization, ACM SIGKDD 2024

- DemandSage, ChatGPT Statistics (mars 2026)

- Incremys, GEO Statistics 2026 (janvier 2026)

- Profound, 10-Step Framework for GEO (juillet 2025)

- Frase.io, What is GEO? Complete Guide (novembre 2025)

- Search Engine Land, Generative Engine Optimization: How to Win AI Mentions (février 2026)

- Enrich Labs, GEO Complete Guide 2026

- Stakque, RAG SEO Guide 2026 (décembre 2025)

- Ralf van Veen, RAG in GEO and Content Ranking (septembre 2025)

- iPullRank, How RAG is Redefining SEO (août 2025)